深入解析Spark集群中jps命令失效的排查与解决之道

凌晨两点,集群监控告警骤然响起,我冲到终端前,习惯性地输入 jps,屏幕却空空如也——关键的 DataNode 进程消失了!ps -ef | grep datanode 却明确显示它仍在运行,这种诡异的 jps "失灵"现象,在 Hadoop/Spark 集群运维中绝非个例,常常让运维人员陷入迷雾。

jps失效的根源探秘:不止于表面现象

jps (Java Virtual Machine Process Status Tool) 失效绝非偶然,其背后隐藏着几种关键诱因:

环境变量错位:无声的路径陷阱

这是最常见的问题,jps 依赖$JAVA_HOME/bin路径,当你在 Shell 中直接执行jps,系统可能使用了错误 JDK 版本下的工具,务必确认:echo $JAVA_HOME which jps # 检查实际执行的 jps 路径是否在 $JAVA_HOME/bin 下

在 Spark 集群中,不同节点配置差异、用户环境变量覆盖(如

.bashrc或.profile设置不当)都可能导致路径混乱。临时目录权限缺失:被拒之门外的通信

jps 需要读取 JVM 运行时创建的hsperfdata_<username>目录(通常位于/tmp),若目录权限错误或磁盘空间耗尽,jps 将无法获取进程列表,检查并修复:ls -ld /tmp/hsperfdata_* # 查看目录权限和所属用户 df -h /tmp # 检查 /tmp 空间 chmod 755 /tmp/hsperfdata_<yourusername> # 示例修正权限

端口冲突与RPC机制:Hadoop的独特挑战

在 Hadoop 生态(HDFS, YARN)中,jps失效常关联java.rmi.server.hostname配置,如果未正确设置或主机名解析失败,JVM 的 RMI 注册将异常,检查关键配置:hadoop-env.sh/yarn-env.sh中的JAVA_OPTS:确保包含-Djava.rmi.server.hostname=<物理网卡IP或正确主机名>。/etc/hosts文件:确认主机名与 IP 映射无误,避免回环地址 (0.0.1或::1) 绑定错误网络接口。- 端口占用冲突:Hadoop 的 NameNode、DataNode 等进程启动时会绑定 RPC 端口(如 9000, 9866, 8042),若端口被其他进程占用,关键服务可能启动失败或行为异常,间接影响 jps 信息,使用

netstat -tulnp | grep <端口号>或lsof -i :<端口号>排查。

特定版本的"顽疾"与兼容性摩擦

某些 Hadoop 版本(如早期 2.x 版本)在特定条件下存在已知 Bug,可能导致 jps 信息不稳定,JDK 版本升级(如从 JDK 8 迁移到 JDK 11+)也可能引入兼容性问题,关注官方 Release Notes 和社区讨论,及时应用修复补丁,对于 Spark 3.0+ 对 JDK 11 的支持,需验证配套 Hadoop 版本是否完全兼容。

精准定位:构建高效的排查流程

面对 jps 失效,遵循系统化的排查步骤至关重要:

- 基础环境验证:

确认JAVA_HOME正确设置且jps路径无误 (which jps),检查目标用户的/tmp/hsperfdata_*目录权限和磁盘空间。 - 进程存活性交叉验证:

立即使用ps -ef | grep -i <进程关键词>(如namenode,datanode,resourcemanager,nodemanager,master,worker) 确认关键进程是否存活。 - 网络与端口深度检测:

- 检查主机名解析 (

hostname -f,ping <hostname>,/etc/hosts)。 - 使用

netstat -tulnp或ss -tulnp查看 Hadoop/Spark 关键端口(如 NameNode RPC 8020/9000, DataNode 9866, YARN ResourceManager 8032, Spark Master 7077, Worker 端口等)是否被正确监听,排除冲突。 - 验证防火墙规则 (

iptables -L -n,firewall-cmd --list-all) 是否阻止了必要的通信(包括 RMI 使用的随机端口)。

- 检查主机名解析 (

- 关键配置审计:

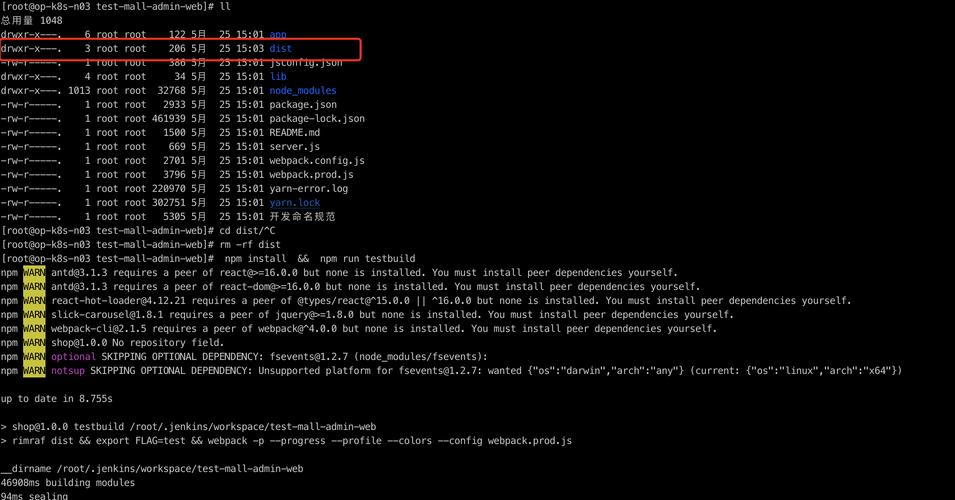

仔细复查hadoop-env.sh,yarn-env.sh,spark-env.sh等环境配置文件,确保JAVA_OPTS包含-Djava.rmi.server.hostname=<正确IP或主机名>,检查HADOOP_*_OPTS,YARN_*_OPTS中的相关设置。 - 日志深挖:故障的最终证人

查阅对应进程的日志文件(HDFS:$HADOOP_HOME/logs/hadoop-<user>-<role>-<hostname>.log, YARN:$HADOOP_HOME/logs/yarn-<user>-<role>-<hostname>.log, Spark:$SPARK_HOME/work/<app-id>/<container-id>/stdout/stderr),搜索ERROR,WARN,Exception以及java.rmi,hostname,bind等关键词,日志往往能直接揭示根本原因。 - 服务重启策略:

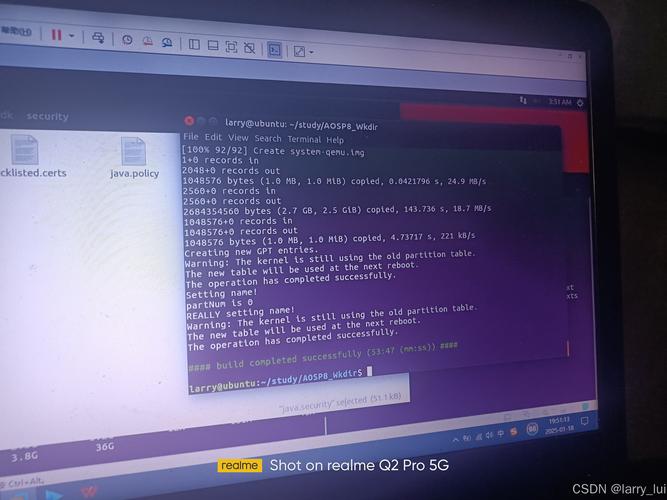

在修正配置或环境问题后,按正确的启动顺序重启受影响的服务(通常顺序:HDFS NameNode -> DataNodes, YARN ResourceManager -> NodeManagers, Spark Master -> Workers)。

实战洞见:运维中锤炼的经验法则

- 环境隔离是基石:为生产集群配置专用的系统级

JAVA_HOME,避免普通用户环境变量覆盖,在启动脚本(如start-dfs.sh,start-yarn.sh,spark/sbin/start-*.sh)中显式设置关键环境变量。 - 主机名配置必须万无一失:确保集群所有节点的主机名配置 (

/etc/hostname,/etc/hosts) 完全一致且能双向解析,使用hostname -f命令验证完全限定域名(FQDN)。 - 端口管理不容疏忽:预先规划并记录集群所有服务的端口使用,利用

netstat/ss定期扫描,防范冲突,考虑使用端口范围限制 (net.ipv4.ip_local_port_range) 减少干扰。 - 权限控制要严谨:确保运行 Hadoop/Spark 进程的用户对

/tmp及其下的hsperfdata_*目录拥有必要的读写权限,定期清理旧的/tmp文件。 - 版本兼容需验证:升级 JDK 或 Hadoop/Spark 大版本前,务必在测试环境充分验证 jps 及其他核心工具的功能完整性,社区资源(Apache JIRA, 邮件列表)是宝贵的信息来源。

那次凌晨的 jps 消失事件,最终定位到 hadoop-env.sh 中缺失 -Djava.rmi.server.hostname 定义,导致 RMI 注册失败,修正后,熟悉的进程列表瞬间重现,这提醒我们,jps 的失效往往是更深层配置或环境问题的表象,掌握其原理,建立清晰的排查路径,保持对基础细节的关注,才能在分布式系统的复杂性中迅速拨云见日——优秀的运维工程师,总能在混乱的日志与消失的进程列表中,找到那条通往稳定的路径,排查时保持耐心,从最基础的环节入手,真相往往藏在最朴素的检查项里。