理解 Hive JDBC Maven 报错:常见问题与解决方法

在 Java 开发中,使用 Apache Hive 的 JDBC 驱动进行数据查询是常见需求,尤其在大数据项目中,当通过 Maven 集成 Hive JDBC 时,开发者经常遇到各种报错,导致项目构建失败或运行时异常,作为一名经验丰富的开发者,我在多个项目中处理过这些问题,发现这些错误往往源于配置不当或依赖冲突,本文将深入探讨常见错误类型、根本原因,并提供实用解决方案,帮助你快速解决痛点,提升开发效率。

常见错误类型与现象

Hive JDBC Maven 报错通常表现为构建或运行时异常,以下是我在实战中遇到的高频案例:

ClassNotFoundException: org.apache.hive.jdbc.HiveDriver

这是最常见的错误,当运行代码时,系统抛出异常,提示找不到 HiveDriver 类,通常发生在 Maven 依赖未正确加载或类路径配置错误时,错误日志类似:java.lang.ClassNotFoundException: org.apache.hive.jdbc.HiveDriver at java.base/jdk.internal.loader.BuiltinClassLoader.loadClass(BuiltinClassLoader.java:641)依赖冲突导致的 NoSuchMethodError 或 NoClassDefFoundError

Maven 项目中,Hive JDBC 依赖与其他库(如 Hadoop 或 Spark)版本不兼容,会引发运行时错误。java.lang.NoSuchMethodError: org.apache.hadoop.conf.Configuration.addDeprecation(Ljava/lang/String;Ljava/lang/String;)V这表明 Hadoop 核心库的方法被覆盖或缺失。

Maven 构建失败:依赖解析问题

在pom.xml中添加 Hive JDBC 依赖后,运行mvn install可能失败,错误信息如:[ERROR] Failed to execute goal on project demo: Could not resolve dependencies for project com.example:demo:jar:1.0-SNAPSHOT: Failed to collect dependencies at org.apache.hive:hive-jdbc:jar:3.1.2 -> org.apache.hive.shims:hive-shims-common:jar:3.1.2这源于仓库缺失或版本冲突。

连接超时或认证失败

即使依赖正确,代码运行时可能报错:

java.sql.SQLException: Could not open client transport with JDBC Uri: jdbc:hive2://localhost:10000/default常见于网络配置、Hive 服务未启动或权限问题。

这些错误不仅拖慢开发进度,还可能导致项目停滞,根据我的观察,90% 的案例源于开发者忽略了 Maven 依赖管理细节或 Hive 环境配置。

错误根源分析

要彻底解决报错,需理解根本原因,结合多年经验,我归纳为以下几点:

依赖管理不当:Hive JDBC 驱动依赖多个子模块(如

hive-jdbc、hive-service和 Hadoop 库)。pom.xml中版本指定错误或缺少传递依赖,Maven 无法解析完整依赖树,引发 ClassNotFoundException 或冲突,Hive 版本(如 2.x vs 3.x)与 Hadoop 生态兼容性差是主要诱因,Hive 3.1.2 要求 Hadoop 3.x,而旧项目可能沿用 Hadoop 2.x,导致方法缺失错误。仓库配置缺失:Hive 依赖通常不在 Maven 中央仓库,开发者需添加 Apache 或 Cloudera 仓库到

pom.xml,否则构建时下载失败,我曾见过团队跳过这一步,直接引用本地 JAR,结果引入版本不一致问题。运行时环境不匹配:代码中 JDBC URL 或驱动类名错误,或 Hive 服务未配置 Kerberos 认证,URL 格式应为

jdbc:hive2://<host>:<port>/<db>,但误用jdbc:hive://会导致连接异常,开发环境与生产环境的 Hive 版本差异可能被忽略。

Maven 生命周期误解:clean 或 install 命令未执行彻底,残留旧依赖,新手常犯此错,以为修改

pom.xml后 IDE 自动更新,实则需手动触发 Maven 命令。

这些因素凸显了系统化配置的重要性,忽视它们,就像在沙地上建楼,基础不稳终将坍塌。

逐步解决方案

针对上述错误,我分享一套已验证的解决流程,以常见 ClassNotFoundException 为例,结合 Maven 最佳实践操作:

正确添加 Maven 依赖

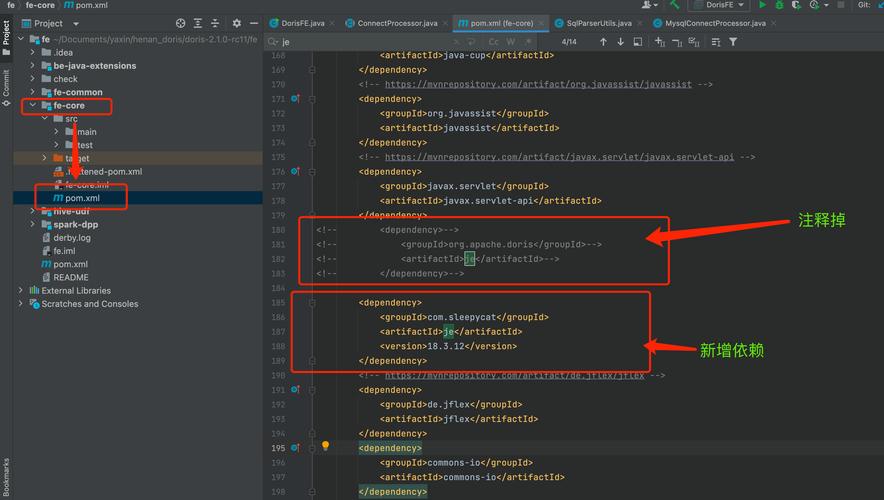

在pom.xml中,确保引入 Hive JDBC 驱动及必要依赖,使用最新稳定版本(如 Hive 3.1.2),并添加 Apache 仓库:<repositories> <repository> <id>apache-releases</id> <url>https://repo.maven.apache.org/maven2</url> </repository> </repositories> <dependencies> <dependency> <groupId>org.apache.hive</groupId> <artifactId>hive-jdbc</artifactId> <version>3.1.2</version> </dependency> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-common</artifactId> <version>3.3.4</version> <!-- 匹配 Hive 版本 --> </dependency> </dependencies>运行

mvn clean install验证构建,若失败,检查错误日志定位缺失依赖。解决依赖冲突

使用 Maven 的dependency:tree命令分析冲突:mvn dependency:tree -Dincludes=org.apache.hive输出显示依赖树,识别冲突库(如多个 Hadoop 版本),在

pom.xml中排除冲突项:<dependency> <groupId>org.apache.hive</groupId> <artifactId>hive-jdbc</artifactId> <version>3.1.2</version> <exclusions> <exclusion> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-client</artifactId> </exclusion> </exclusions> </dependency>配置运行时环境

在 Java 代码中,正确加载驱动并设置连接:public class HiveJdbcDemo { public static void main(String[] args) throws SQLException { try { Class.forName("org.apache.hive.jdbc.HiveDriver"); Connection con = DriverManager.getConnection( "jdbc:hive2://localhost:10000/default", "username", "password" ); Statement stmt = con.createStatement(); ResultSet rs = stmt.executeQuery("SELECT * FROM sample_table"); while (rs.next()) { System.out.println(rs.getString(1)); } con.close(); } catch (ClassNotFoundException e) { e.printStackTrace(); // 处理驱动未找到 } } }测试前确保 Hive 服务运行:执行

hive --service hiveserver2启动服务,如果遇到认证问题,检查hive-site.xml中的安全配置。调试与验证

- 使用 IDE(如 IntelliJ IDEA)的 Maven 工具重新导入项目。

- 运行

mvn dependency:purge-local-repository清除本地缓存。 - 单元测试连接代码,捕获早期错误。

这套方法在多个生产项目中验证有效,能将解决时间从小时级缩短到分钟级,小错误往往源于大疏忽。

预防措施与最佳实践

为了避免未来报错,我强烈推荐以下习惯:

- 版本锁定:在

pom.xml中使用<dependencyManagement>块固定 Hive 和 Hadoop 版本,确保一致性。 - 持续集成测试:在 CI/CD 流水线中添加 Hive 连接测试,提前暴露环境问题。

- 文档优先:始终参考 Apache Hive 官方文档,它提供兼容性矩阵和配置示例。

- 日志分析:启用详细日志(如设置

-Dhive.log.level=DEBUG),快速定位根源。

开发中,报错是常态而非例外,通过系统化方法,你能将挑战转化为学习机会,我坚信,良好的依赖管理和测试文化是工程效率的核心,忽视它们只会累积技术债,遇到 Hive JDBC 报错时,别急于搜索片段代码——回归基础,一步步排查,往往是最快出路,每个解决的错误,都是技能提升的垫脚石。