在信息泛滥的时代,数据的准确性不再是可有可无的附加项,而是决定决策质量、影响信誉根基的核心要素,无论是企业战略规划,还是日常运营分析,失之毫厘的数据都可能导致谬以千里的结果,如何系统地构建一道坚固的防线,以确保我们所依赖的数据是真实、可靠的呢?

正本清源:从数据产生的源头把关

确保数据准确性,首先是一场“源头保卫战”,如果数据在诞生之初就存在瑕疵,后续无论进行多么复杂的清洗与修正,都如同在沙地上建造高楼,根基不稳。

- 设计清晰的数据规范:在数据采集环节之前,必须建立统一、明确的数据标准与定义,对于“用户活跃度”,必须清晰界定其计算口径——是登录即算活跃,还是必须完成某个核心操作?统一的规范能有效避免因理解偏差导致的数据混乱。

- 优化数据录入界面与流程:对于需要人工录入的数据,界面设计应尽可能人性化,采用下拉选择、格式自动校验、必填项提示等技术手段,减少手动输入的错误空间,简化录入步骤,降低操作复杂度,也能有效提升原始数据的质量。

- 利用技术手段自动采集:在条件允许的情况下,应优先采用系统接口、传感器、日志文件等自动化方式采集数据,自动化能最大限度地排除人为干扰,从源头上保证数据的客观与一致。

过程管控:建立规范的数据处理流程

数据从源头产生后,会经历传输、清洗、整合、计算等多个环节,这是一个动态过程,同样需要严密的监控与管理。

- 构建可追溯的数据流水线:现代数据处理往往依赖ETL或ELT等流程,确保这些流程的每个步骤都是透明、可追溯的,记录数据在每个节点的状态和变化,一旦发现问题,可以快速定位到出错的环节,实现精准修复。

- 实施定期的数据清洗与校验:即便源头数据无误,在流动过程中也可能因系统故障、网络异常等问题产生“脏数据”,建立定期的数据清洗机制,通过设定规则来识别并处理重复值、异常值、缺失值和格式错误,可以引入数据校验规则,检查不同报表中同一指标的数据是否能够相互印证。

- 强化权限管理与变更控制:并非所有人都应有权限修改核心数据,建立严格的角色权限体系,确保只有授权人员才能对关键数据进行操作,对数据模型的任何变更,都应遵循规范的审批与测试流程,防止因随意改动引发系统性的数据错误。

技术赋能:善用工具进行交叉验证与监控

工欲善其事,必先利其器,合理利用技术工具,能让数据准确性的保障工作事半功倍。

- 搭建数据质量监控平台:可以部署或开发数据质量监控系统,对关键数据指标设置监控规则和阈值,一旦数据波动超出合理范围,或出现断崖式下跌/飙升,系统能自动发出警报,提醒相关人员及时介入排查。

- 进行多维度交叉验证:不要孤立地相信单一数据源,尝试从不同系统、不同角度获取数据进行交叉比对,将业务数据库的记录与日志系统的记录进行核对,或将自身统计的数据与可靠的第三方行业报告进行趋势对比,当多个独立来源的数据指向同一结论时,我们的信心才会更加充足。

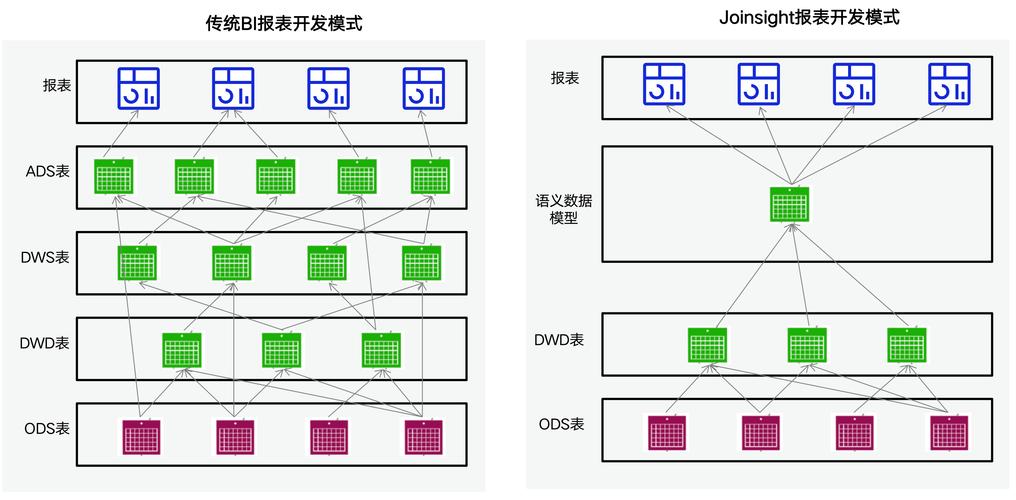

- 引入数据血缘分析:数据血缘图可以清晰地展示数据的来龙去脉,从最终的报告图表追溯到最原始的数据库表,这不仅能帮助理解数据,更能快速评估当某个源头数据或处理过程发生变化时,会影响到下游哪些报表和应用,从而进行有针对性的检查和沟通。

以人为本:培育团队的数据责任意识

技术和流程最终需要人来执行和维护,培养团队成员对数据的敬畏心和责任感,是确保数据准确性的软实力,也是根本保障。

- 明确数据权责:在组织内,每一项关键数据都应有明确的负责人,他需要对这条数据的定义、质量、安全和使用负责,这种清晰的权责划分,能有效避免出现问题时互相推诿、无人负责的局面。

- 持续的数据素养培训:定期为相关员工提供数据知识和技能的培训,让他们理解数据准确性的重要性,掌握正确处理数据的方法,并能够识别常见的数据问题,当每个人都成为数据质量的“守门员”时,整个系统的稳健性将大大增强。

- 建立正向的激励与反馈机制:将数据质量纳入团队或个人的绩效考核体系之一,对于主动发现并上报数据问题的行为给予肯定和奖励,建立一个通畅的反馈渠道,鼓励所有人在发现任何数据疑点时,都能毫无顾虑地提出。

数据的准确性并非一蹴而就,它是一项需要持续投入、精心维护的系统工程,它要求我们将严谨的态度、科学的流程、智能的工具和负责的文化有机地结合起来,编织成一张疏而不漏的质量保障网,在这张网的守护下,数据才能真正发挥其价值,成为驱动我们前进的可靠罗盘,而非误导方向的迷雾。